电磁仿真单机与集群方案对比:何时应该升级到集群计算? ——从GHz到THz,从电小尺寸到电大目标,电磁仿真工程师的算力突围之路

时间:2026-02-25 21:43:18

来源:UltraLAB图形工作站方案网站

人气:72

作者:管理员

引言:当单机的风扇彻夜长啸,你是否该考虑集群了?

凌晨两点,实验室里那台配备了双路Xeon和1TB内存的UltraLAB图形工作站依然在轰鸣。ANSYS HFSS的求解进度条卡在了87%,任务管理器显示内存占用已达到980GB,而下一个频率点的离散扫频(Discrete Sweep)还未开始。你的手机震动,是导师发来的消息:"这次5G基站阵列的S参数仿真,周一能出结果吗?"

你望着屏幕上那个复杂的64单元相控阵模型,陷入了沉思:是再加几条内存坚持一下,还是该向学院申请集群计算资源了?或者,投资一套小型集群方案是否更划算?

这是每一个从事电磁兼容(EMC)、天线设计、雷达散射截面(RCS)分析或高速互连信号完整性(SI)研究的工程师都会面临的算力临界点困境。

作为UltraLAB定制计算解决方案团队,我们在服务清华、北航、电科集团、华为2012实验室等顶级电磁仿真用户的过程中,深刻认识到:电磁仿真领域的"单机"与"集群"之争,绝非简单的"核数堆砌"或"预算多少"问题,而是由算法本质、模型电尺寸、扫频策略与数据粒度共同决定的工程经济学问题。

本文将从Maxwell方程组的数值求解底层逻辑出发,深度剖析电磁仿真中的硬件瓶颈,并给出科学、可量化的升级决策框架。

一、电磁仿真计算的物理本质与硬件需求特征

1.1 频域有限元法(FEM)的"内存墙"困境

以ANSYS HFSS为代表的频域求解器,采用有限元法离散Maxwell方程,最终归结为求解大型稀疏线性方程组:

Ax=b

其中 A 是复数稀疏刚度矩阵,其规模与网格未知数(未知电场分量)成正比。关键瓶颈在于:频域FEM主要采用直接求解器(Direct Solver,如MUMPS、PARDISO),需要进行矩阵的LU分解。

硬件需求特征:

-

内存容量指数级增长:对于电大尺寸模型,矩阵因子化后的非零填充(Fill-in)导致内存需求与未知数的1.2-1.5次方成正比。一个1000万未知数的模型,峰值内存占用可能达到600GB-1TB。

-

内存带宽敏感:LU分解过程中的大量随机内存访问,使得内存带宽(而非CPU核心数)成为性能瓶颈。实测表明,八通道DDR5(~400GB/s)相比四通道(~200GB/s),求解时间可缩短30-40%。

-

并行扩展性受限:直接求解器的并行度受限于消元树(Elimination Tree)的深度,超过16-32核后,加速比急剧下降。

1.2 时域有限积分法(FIT)与有限元法(FEM)的差异化需求

CST Microwave Studio的时域求解器采用Leapfrog算法,具有显式迭代特征:

-

内存需求线性增长:与网格数成正比,通常比同规模频域问题内存需求低1个数量级

-

计算密集度高:每时间步长内为局部 stencil 计算,CPU缓存友好

-

GPU加速友好:CUDA加速可带来5-10倍性能提升,适合单机多卡方案

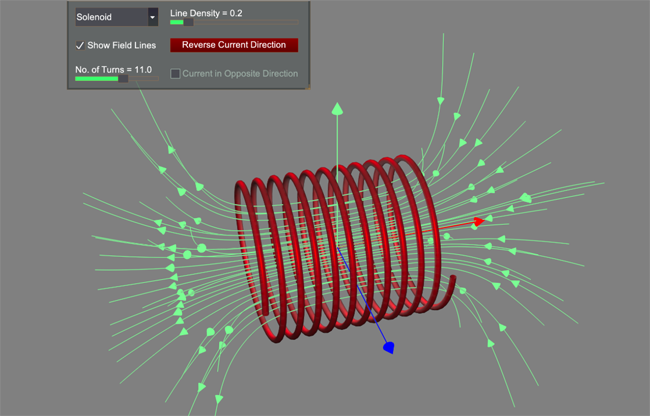

1.3 混合算法与多物理场耦合的现代趋势

现代电磁仿真已超越纯电磁范畴:

-

电热耦合:天线辐射功率→热耗散→材料介电常数温度漂移→电磁性能变化

-

电磁-结构耦合:高功率下的结构形变对相位的影响

-

大规模系统级仿真:整车EMC、整机柜高速互连

这些场景往往涉及多尺度网格(从微米级PCB线宽到米级机箱)和宽频带响应(DC-100GHz),单机资源很快触及天花板。

二、单机方案的极限边界:UltraLAB工作站的能力象限

2.1 单机方案的甜蜜点

在以下场景,一台配置合理的UltraLAB高端工作站仍是性价比最优解:

场景A:电小尺寸/谐振结构精细分析

-

模型尺寸 < 5个波长(λ)

-

网格数 < 2000万

-

扫频策略:插值扫频(Interpolating Sweep)或快速扫频(Fast Sweep)

-

典型应用:手机天线、连接器、滤波器、PCB过孔优化

场景B:时域单次激励仿真

-

CST时域求解器,脉冲激励覆盖全频段

-

可采用GPU加速(NVIDIA RTX 4090/A6000)

-

内存需求 < 256GB

场景C:参数化扫描与优化设计前期

-

利用单机的交互性优势,快速进行"what-if"分析

-

基于DX(DesignXplorer)或Optimetrics的本地并行(Parametric Parallel)

2.2 单机硬件配置的黄金法则

针对HFSS等频域求解器,UltraLAB推荐以下单机极致配置:

UltraLAB EX650i 电磁仿真工作站

-

CPU:Intel Xeon W9-3495X(56核112线程,睿频4.8GHz)

-

选型逻辑:八通道DDR5-4800,提供~460GB/s内存带宽,缓解直接求解器带宽瓶颈

-

-

内存:1.5TB DDR5-4800 ECC REG(12×128GB)

-

支持策略:应对2000万+未知数的大规模矩阵分解

-

-

存储:系统盘2TB NVMe Gen4 + 高速缓存盘4TB NVMe U.2企业级

-

用于存储庞大的因子化矩阵文件(.rst文件常达数百GB)

-

-

加速:NVIDIA RTX A6000 48GB(用于SBR+射线追踪或AI加速网格划分)

性能基准:在上述配置下,求解一个1200万未知数的5G毫米波阵列天线(28GHz,离散扫频5个频点),可在18小时内完成,而普通双路服务器(256GB内存)将无法完成求解(内存溢出)。

三、集群计算的必要性:突破单机物理极限的四个信号

当你的仿真需求出现以下特征时,集群(Cluster)不再是可选项,而是必选项:

信号一:内存需求突破单节点上限(~2TB)

技术现实:目前主流服务器平台(Intel Xeon Scalable、AMD EPYC)的单节点最大内存容量受限于内存通道数与单条容量。即使使用12通道的Intel Max系列,实际配置超过2TB内存时,成本将呈指数级上升,且频率会降频至4000MT/s以下。

典型场景:

-

整车(整车尺寸5米)宽带EMC分析(30MHz-1GHz),网格数 > 5000万

-

超电大平台RCS分析(电尺寸 > 100λ),使用SBR+与MLFMM混合算法

-

芯片-封装-系统(Chip-Package-System)协同仿真,跨尺度网格 > 1亿单元

集群优势:通过MPI(Message Passing Interface)分布式内存并行,将矩阵分块存储于多节点内存,突破单节点物理限制。

信号二:多频点/多端口扫描的"尴尬并行"

HFSS的离散扫频(Discrete Sweep)与端口激励求解具有天然的任务级并行性:

-

每个频点独立求解(频域有限元)

-

每个端口激励独立求解(线性系统右端项不同)

单机困境:即使拥有56核CPU,HFSS的单个频点求解只能利用8-16核(受限于直接求解器并行度),剩余核心空转。

集群方案:使用ANSYS DSO(Distributed Solve Option)或自定义Python调度脚本,将不同频点/激励分配至不同节点并行求解。一个8节点集群(每节点32核),可将100个频点的扫频任务从单机的200小时缩短至3小时(理想情况下)。

信号三:瞬态多物理场的时间步长累积

电磁-热耦合或电磁-力学耦合仿真需要数百至数千个时间步长或耦合迭代步:

-

单机计算需要数周时间

-

任何意外断电都需从t=0重新开始

集群价值:

-

断点续算(Checkpoint/Restart):利用集群存储系统定期保存状态

-

作业调度(Job Scheduler):SLURM/PBS Pro支持任务队列、优先级管理、资源预留

-

高可用性:企业级集群的双路电源、ECC内存纠错、RAID存储冗余

信号四:设计优化与机器学习的算力饥饿

现代电磁设计已融入:

-

遗传算法/粒子群优化:数百次重复仿真

-

代理模型(Surrogate Model):基于神经网络替代全波仿真,需批量生成训练数据

-

不确定性量化(UQ):蒙特卡洛分析需数千次采样

集群架构:此类易并行(Embarrassingly Parallel)任务适合采用"网格计算"(Grid Computing)模式,通过UltraLAB集群管理软件,将数百个小型任务分发至集群节点,实现近线性的加速比。

四、集群架构的关键技术瓶颈与UltraLAB解决方案

4.1 网络拓扑:被低估的"通信墙"

许多用户误以为"集群=多机堆叠",却忽视了网络延迟对电磁仿真的致命影响。

技术细节:

频域FEM的分布式并行(Domain Decomposition Method, DDM)需要在子域交界面上迭代交换边界场值。若使用千兆以太网(延迟~100μs),通信时间将淹没计算时间。

UltraLAB集群方案:

-

计算网络:InfiniBand HDR(100Gbps,延迟<1μs)或RoCE v2

-

管理网络:独立千兆以太网,避免与计算流量争抢

-

拓扑结构:Fat-Tree或Dragonfly+,确保任意两节点间无阻塞带宽

4.2 存储架构:并行文件系统的必要性

电磁仿真集群产生海量小文件与超大文件混合负载:

-

网格文件(.msh):数十GB

-

结果文件(.fld):每频点数十GB

-

日志与中间变量:数百万个小文件

UltraLAB存储配置:

-

Lustre并行文件系统:聚合带宽>50GB/s,支持数千客户端并发

-

分层存储:热数据(NVMe SSD池)+ 温数据(SAS HDD)+ 冷数据(磁带库/对象存储)

-

** burst buffer技术**:节点本地NVMe作为计算缓存,减少对传统存储的随机IO冲击

4.3 软件许可(License)的集群适配

ANSYS HFSS、CST Studio等商业软件采用FlexNet许可,在集群环境下需配置:

-

License Server冗余:双机热备,避免单点故障导致全集群停摆

-

模块计数管理:HPC Pack许可(如ANSYS HPC Pack 512)决定最大并行核数

-

** token 竞争策略**:队列系统与License Manager联动,避免作业启动后因无License而挂起

五、决策矩阵:何时升级?如何升级?

基于上述分析,UltraLAB提出"三维决策模型":

| 维度 | 单机方案(UltraLAB EX650i) | 小型集群(4-8节点) | 中大型集群(16+节点) |

|---|---|---|---|

| 模型规模 | < 2000万网格 | 2000万-1亿网格 | > 1亿网格 |

| 扫频策略 | 插值扫频/快速扫频 | 离散扫频 < 50频点 | 离散扫频 > 100频点 |

| 内存需求 | < 1.5TB | 1.5TB-6TB(分布式) | > 6TB |

| 并行类型 | 共享内存(OpenMP) | 混合并行(MPI+OpenMP) | 纯MPI分布式 |

| 作业特征 | 交互式调试 | 批量参数化扫描 | 全自动优化/AI训练 |

| 投资预算 | 15-30万元 | 60-150万元 | 300万元+ |

| 运维复杂度 | 低(单机箱维护) | 中(需基础IT支持) | 高(专业HPC工程师) |

升级路径建议:

阶段一(起步):单台UltraLAB EX650i(56核/1.5TB内存),应对80%的日常仿真任务,预算可控,维护简单。

阶段二(扩展):当遇到内存瓶颈时,不急于购买第二台大内存机器,而是采用"胖节点+调度"策略:保留EX650i作为前处理与后处理工作站,新增2-4台标准计算节点(256GB内存/每节点),通过10GbE网络组成迷你集群,运行DSO并行扫频。总投资增加40万,吞吐量提升3-5倍。

阶段三(集群化):当团队规模>10人,年仿真任务>5000个,且涉及多物理场耦合时,部署UltraLAB Spectrum集群方案:16+节点,InfiniBand网络,Lustre存储,配合Slurm作业调度与ANSYS RSM(Remote Solve Manager)集成,实现仿真资源的池化管理。

六、隐性成本考量:TCO(总拥有成本)分析

许多实验室在购买集群时只关注硬件CAPEX(资本支出),却忽略了:

-

功耗与散热:一台1kW工作站年电费约8000元,而一个32节点集群(每节点800W)年电费超20万元,且需专业机房空调(精密空调而非普通空调)

-

人力成本:集群需要专业的Linux系统管理员、HPC工程师,年薪成本远超硬件折旧

-

软件许可:HPC Pack许可费用常是硬件成本的2-3倍

UltraLAB的"轻量级集群"理念:

针对高校科研团队,我们提供预配置、预优化、预调试的Turnkey集群方案:

-

出厂预装CentOS/Rocky Linux、Intel MPI、Ansys RSM

-

提供基于Web的作业提交界面(Open OnDemand),降低非计算机专业用户的使用门槛

-

"工作站即集群头节点"架构:EX650i既可作为强力单机,又可作为集群登录/管理节点,保护初期投资

结语:没有最好的方案,只有最合适的算力

从麦克斯韦方程组的离散化到GHz频段的波束赋形,电磁仿真始终在追求"更电大、更宽带、更精确"的极限。单机与集群的选择,本质上是"交互响应性"与"极限吞吐率"的权衡:

-

如果你需要随时调整模型、观察场分布、快速验证设计变更——单机工作站仍是你的主战武器。

-

如果你面临的是标准化、批量化的仿真任务,内存需求无止境,且能容忍数小时的队列等待——集群计算将释放你的时间。

UltraLAB深耕电磁仿真计算领域多年,我们不仅提供从单节点到数百节点的全谱系硬件,更重要的是提供"仿真特征-硬件匹配"的咨询服务。无论你是面临毕业压力的博士生,还是规划实验室建设的PI,我们都能基于你的具体软件组合(HFSS/CST/FEKO/JMAG)、典型模型尺寸与预算约束,给出科学的算力规划建议。

算力的价值不在于堆叠,而在于让工程师的灵感不再等待。当你下一次看到HFSS的进度条停滞不前时,不妨联系UltraLAB,让我们帮你诊断:是再加一条内存,还是该迈向集群化的下一个阶段。

关于UltraLAB电磁仿真解决方案

UltraLAB为电磁仿真领域提供从个人工作站到企业级集群的全栈计算解决方案,支持ANSYS HFSS、CST Studio Suite、Altair Feko、COMSOL Multiphysics等主流软件优化部署。我们的技术团队拥有深厚的电磁算法与HPC架构背景,致力于让每一赫兹的算力都转化为工程创新的加速度。

获取《电磁仿真硬件配置白皮书》或预约集群架构咨询,请访问我们的技术官网或联系区域销售经理。

上一篇:没有了