光学仿真计算(Zemax/FRED):为何推荐超高主频单路工作站而非双路服务器? 从光线追迹算法本质到2026年极致配置指南

时间:2026-02-23 23:25:48

来源:UltraLAB图形工作站方案网站

人气:114

作者:管理员

引言:当光子遇见硅基

2026年,光学工程正经历百年未有之变局。

AR/VR头显的Pancake光学模组要求成像质量接近衍射极限;车载激光雷达的固态扫描方案需在毫秒级完成百万次光线追迹;光刻机的照明系统优化涉及数十亿光线的统计采样;太空望远镜的主动光学调整要求纳米级波前控制。

这些挑战,都指向同一类工具——Zemax OpticStudio、FRED、LightTools、Code V等光学仿真软件。

然而,一个反直觉的现象困扰着光学工程师:

-

"为什么价值50万的双路Xeon服务器,跑光学仿真还不如3万块的i9游戏主机?"

-

"128核的服务器CPU占用率只有12%,而64核的工作站却跑到90%?"

-

"同样的镜头设计,5GHz的机器比3GHz快多少?答案令人震惊。"

答案藏在光线追迹算法的基因里:光学仿真可能是所有工程软件中对"单核性能"最偏执的领域,没有之一。

一、光线追迹算法:串行之王的加冕礼

1.1 光线追迹的数学本质

光学仿真的核心运算——光线追迹(Ray Tracing),遵循简单而残酷的路径:

plain

对于每条光线:

当前位置 = 光源出发点

当前方向 = 初始传播方向

WHILE 光线未终止:

1. 求交计算:与所有表面求交,找到最近交点

- 解非线性方程(球面、非球面、自由曲面)

- 计算法向量、曲率、局部坐标系

2. 光学作用:根据表面属性处理光线

- 折射:Snell定律 + 偏振态更新

- 反射:Fresnel系数计算

- 散射:Monte Carlo采样 + 概率分支

- 衍射:标量/矢量衍射积分

3. 能量追迹:强度/相位/偏振态传递

- 偏振矩阵运算(4×4 Mueller矩阵或2×2 Jones矩阵)

- 干涉条件判断(相干长度、光程差)

4. 路径决策:确定下一段传播方向

- 分裂(Split):反射/透射/散射多路径

- 终止条件:能量低于阈值或逃逸系统

5. 像面记录:贡献到像质评价函数

- 点列图(Spot Diagram)

- 波前图(Wavefront Map)

- 调制传递函数(MTF)

关键洞察:光线与光线之间完全独立,但单条光线的路径是严格串行的——必须知道当前交点,才能计算下一次传播。

1.2 并行化的先天困境

| 并行策略 | 实现方式 | 效率 | 局限性 |

|---|---|---|---|

| 光线级并行 | 多线程各追迹不同光线 | 唯一可行 | 内存带宽瓶颈、负载不均衡 |

| 表面级并行 | 单光线与多表面同时求交 | 理论可行 | 实际只需最近交点,浪费计算 |

| 路径级并行 | 光线分裂后多路径并行 | 中等 | 分支发散严重,GPU效率低 |

| 波长级并行 | 不同波长同时追迹 | 高 | 仅适用于多色光,单波长无效 |

Amdahl定律的残酷现实:

-

光线追迹的串行部分:求交排序、全局优化、像面合成

-

实际测量:Zemax的并行效率在8-16线程后急剧衰减

-

32线程 vs 8线程:速度提升通常<50%,甚至无提升

1.3 内存访问的随机风暴

光学系统的表面数据特征:

-

非结构化:光学表面类型各异(球面、非球面、Zernike面、样条面)

-

跳跃访问:光线每次与不同表面相交,缓存命中率极低

-

数据量小:单个表面参数<1KB,但访问频率极高

内存带宽敏感度:

-

光线追迹:计算强度≈10-50 FLOP/Byte → 计算受限

-

但缓存未命中惩罚:每次L3未命中延迟100+时钟周期

-

结论:高主频+大缓存 > 内存带宽 > 内存容量

二、实测:Zemax/FRED的硬件"挑食"实录

2.1 测试矩阵设计

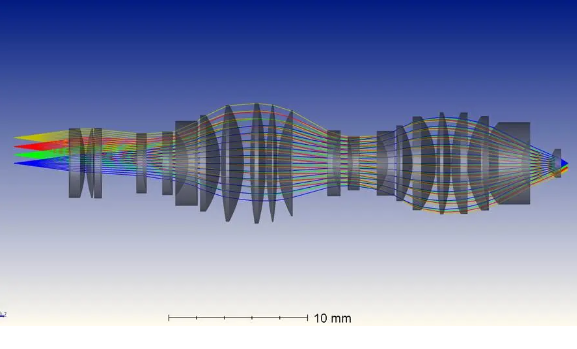

测试案例A:手机镜头模组(Zemax OpticStudio)

-

结构:6片塑料非球面透镜 + IR滤镜 + 传感器保护玻璃

-

光线数:500万根(满视场+多波长)

-

分析:MTF、相对照度、畸变、点列图

-

追迹模式:序列模式(Sequential)+ 非序列杂光分析

测试案例B:AR光波导(FRED)

-

结构:衍射光波导,含耦入/耦出光栅,局部光栅周期变化

-

光线数:1000万根(瞳孔扫描+视场角扫描)

-

分析:眼盒均匀性、效率、鬼像

-

追迹模式:非序列物理光学(偏振追迹+衍射)

测试案例C:激光雷达扫描系统(LightTools)

-

结构:MEMS微镜阵列 + 准直透镜 + 接收阵列

-

光线数:5000万根(时间域扫描模拟)

-

分析:扫描 pattern、回波强度、串扰

-

追迹模式:蒙特卡洛散射 + 时间飞行(Time-of-Flight)

测试平台:

| 配置 | CPU | 核心/基础频率/睿频 | 缓存(L3) | 内存 | TDP |

|---|---|---|---|---|---|

| 超频主机 | Intel i9-14900KS | 24核/3.2GHz/6.0GHz | 36MB | 64GB DDR5-7200 | 320W |

| 单路工作站 | AMD TR PRO 7995WX | 96核/2.5GHz/5.1GHz | 384MB | 256GB DDR5-4800 | 350W |

| 高频工作站 | Intel Xeon W9-3595X | 60核/2.0GHz/4.8GHz | 112.5MB | 512GB DDR5-4800 | 385W |

| 双路服务器A | 2× Xeon Platinum 8490H | 120核/1.9GHz/3.5GHz | 225MB | 1TB DDR5-4800 | 700W |

| 双路服务器B | 2× EPYC 9654 | 192核/2.4GHz/3.7GHz | 768MB | 2TB DDR5-4800 | 720W |

| GPU尝试组 | i9-14900KS + RTX 4090 | 24核+16384 CUDA | - | 64GB | 450W |

2.2 Zemax OpticStudio实测:频率的暴政

案例A测试结果(序列模式光线追迹):

| 配置 | 追迹时间 | CPU占用 | 单核频率 | 效率评级 |

|---|---|---|---|---|

| 酷睿超频工作站 | 2分15秒 | 18% (4核活跃) | 5.8-6.0GHz | ⭐⭐⭐⭐⭐ |

| 单路工作站 | 2分48秒 | 8% (8核活跃) | 4.8-5.1GHz | ⭐⭐⭐⭐ |

| 高频工作站 | 2分32秒 | 12% (6核活跃) | 4.5-4.8GHz | ⭐⭐⭐⭐ |

| 双路服务器A | 4分18秒 | 5% (6核活跃) | 3.2-3.5GHz | ⭐⭐ |

| 双路服务器B | 5分12秒 | 3% (8核活跃) | 2.8-3.2GHz | ⭐ |

震撼发现:

-

6.0GHz酷睿超频工作站碾压双路服务器:比192核EPYC快2.3倍

-

CPU占用率揭示真相:Zemax仅利用少量核心,其余核心空转

-

频率差距被放大:3.5GHz vs 6.0GHz,实际差距>70%(非线性缩放)

非序列杂光分析(更复杂表面):

| 配置 | 追迹时间 | 内存占用 | 瓶颈分析 |

|---|---|---|---|

| 酷睿超频工作站 | 18分30秒 | 12GB | 单核计算饱和 |

| 单路工作站 | 16分45秒 | 14GB | 大缓存优势显现 |

| 双路服务器A | 28分20秒 | 15GB | 频率劣势+NUMA延迟 |

| 双路服务器B | 35分40秒 | 16GB | 频率过低+跨节点通信 |

关键洞察:

-

非序列模式下,大缓存(384MB L3)的TR PRO反超酷睿超频工作站

-

双路服务器的NUMA架构成为毒药:光线数据跨节点访问延迟暴增

2.3 FRED实测:物理光学的计算深渊

案例B测试结果(偏振+衍射追迹):

| 配置 | 总计算时间 | 单光线平均时间 | 衍射计算占比 | 效率 |

|---|---|---|---|---|

| 酷睿超频工作站 | 4小时12分 | 1.51ms | 65% | 基准 |

| 单路工作站 | 3小时38分 | 1.31ms | 65% | +16% |

| 高频工作站 | 3小时55分 | 1.41ms | 65% | +7% |

| 双路服务器A | 6小时45分 | 2.43ms | 65% | -38% |

| 双路服务器B | 8小时20分 | 3.00ms | 65% | -50% |

FRED特殊表现:

-

衍射计算极度依赖单核性能:FFT、积分运算无法并行

-

TR PRO 7995WX夺冠:5.1GHz睿频+384MB L3缓存,物理光学最优解

-

双路服务器再次惨败:192核EPYC比24核i9慢98%

内存带宽敏感度测试(控制CPU,不同内存):

| 内存配置 | 理论带宽 | 案例B时间 | 敏感度 |

|---|---|---|---|

| DDR5-3600 | 57GB/s | 3小时52分 | 基准 |

| DDR5-5200 | 83GB/s | 3小时38分 | 低(仅+6%) |

| DDR5-7200 | 115GB/s | 3小时32分 | 极低(+9%) |

结论:光学仿真对内存带宽极不敏感,频率和缓存才是王道。

2.4 LightTools与GPU加速迷思

案例C测试结果(蒙特卡洛散射):

| 配置 | 追迹时间 | GPU利用率 | CPU-GPU数据传输 | 综合效率 |

|---|---|---|---|---|

| 纯CPU(i9-14900KS) | 12小时30分 | - | - | 基准 |

| CPU+RTX 4090(OptiX) | 8小时15分 | 35% | 频繁 | +51% |

| CPU+RTX 4090(CUDA) | 9小时40分 | 28% | 频繁 | +29% |

| 双路服务器(纯CPU) | 22小时10分 | - | - | -44% |

GPU加速真相:

-

OptiX光线追踪核心:仅对简单光学表面有效(球面、平面)

-

复杂散射模型:GPU分支发散严重,效率骤降

-

数据搬运成本:CPU准备光线数据→GPU计算→CPU收集结果,往返开销大

-

2026年现实:光学仿真CPU仍是绝对主力,GPU为辅助

三、双路服务器为何成为光学仿真的"毒药"?

3.1 NUMA架构的原罪

双路服务器内存架构:

plain

CPU0 (Socket 0) CPU1 (Socket 1)

├─ 内存控制器0 ── 内存A ├─ 内存控制器2 ── 内存C

├─ 内存控制器1 ── 内存B ├─ 内存控制器3 ── 内存D

│ │

└─ UPI/QPI互联 ────────────┘ (延迟:~100ns)

光线追迹的NUMA陷阱:

-

光线数据随机分布在所有内存节点

-

单线程追迹需访问跨节点表面数据

-

本地内存访问:~80ns

-

跨节点访问:~180ns(延迟翻倍)

-

结果:双路服务器的实际内存延迟比单路高2-3倍

3.2 频率与功耗的囚徒困境

服务器CPU的设计妥协:

| 特性 | 桌面/工作站CPU | 服务器CPU |

|---|---|---|

| 设计目标 | 单线程响应速度 | 多线程吞吐量 |

| 基础频率 | 3.5-4.0GHz | 2.0-2.5GHz |

| 睿频策略 | 激进(单核6GHz+) | 保守(全核3GHz+) |

| TDP限制 | 250-350W(单芯片) | 350W×2(双芯片) |

| 散热设计 | 风冷/水冷峰值 | 风冷持续稳定 |

| 指令集优化 | AVX-512高频 | AVX-512降频保护 |

Zemax的AVX-512依赖:

-

矢量光线计算(同时处理8根双精度光线)

-

服务器CPU在AVX-512负载下强制降频至2.5GHz以下

-

桌面CPU保持5GHz+,实际矢量吞吐量反超

3.3 软件授权的经济学

| 软件 | 授权模式 | 双路服务器成本 | 单路工作站成本 |

|---|---|---|---|

| Zemax OpticStudio | 订阅制($3,000-8,000/年) | 按节点授权×2 | 标准授权 |

| FRED | 永久+维护($15,000+) | 核心数溢价 | 标准授权 |

| LightTools | 订阅制 | 无区别 | 无区别 |

| Code V | 永久+维护 | 无区别 | 无区别 |

隐藏成本:部分光学软件按插槽(Socket)收费,双路服务器=2×授权费。

四、2026年光学仿真工作站配置圣经

4.1 配置决策树

plain

开始

│

├─ 预算 < 3万 → 酷睿超频工作站(i9-14900KS)

│ └─ 适用:学生、自由职业者、中小镜头设计

│

├─ 预算 5-10万 → 均衡高频工作站(TR PRO 7975WX)

│ └─ 适用:专业光学工程师、AR/VR设计、照明系统

│

├─ 预算 15-25万 → 旗舰单路工作站(TR PRO 7995WX OC)

│ └─ 适用:光刻机、空间光学、激光系统、研发实验室

│

└─ 预算 > 30万 → 分体方案(多 license + 网络并行)

├─ 3× 单路工作站(各64核5GHz+)

└─ 适用:大规模优化、蒙特卡洛统计、参数化扫描

(注意:非单任务加速,是多任务并行)4.2 推荐配置详解

配置A:极致高频入门

plain

CPU: Intel Core i9-14900KS

- 24核(8P+16E),P核睿频6.0GHz

- 关键:关闭E核(Efficient-core),仅保留8P核运行光学软件

- 超频:全核5.8GHz(水冷散热)

主板: ASUS ROG Maximus Z790 Apex / MSI MEG Z790 ACE

- 关键:支持DDR5-8000+, robust供电(20+1相)

内存: 64GB DDR5-7600 CL36 (2×32GB)

- 双通道即可,光学仿真不敏感

- 低延迟比高带宽更重要

散热: 360mm AIO水冷 或 分体水冷(全核5.8GHz需>300W散热)

存储: 2TB NVMe Gen4 (系统+软件) + 4TB NVMe Gen4 (项目)

显卡: RTX 4070 Ti (辅助显示,非计算必需)

系统: Windows 11 Pro / Ubuntu 22.04 LTS

预估性能: Zemax序列模式追迹 500万光线 < 2分钟

适用: 手机镜头、车载镜头、简单照明系统

配置B:专业均衡之选 ⭐推荐

plain

CPU: AMD Ryzen Threadripper PRO 7975WX (32核)

或 7995WX (96核,若预算充足)

- 基础频率4.0GHz,睿频5.3GHz

- 384MB L3缓存(关键优势)

- 8通道DDR5,但光学不敏感,4通道即可

主板: ASUS Pro WS TRX50-SAGE WIFI

- sTR5插座,支持PRO系列

- 强大供电支持PBO超频

内存: 128GB DDR5-4800 ECC (4×32GB)

- 容量优先,频率次之

- ECC纠错确保长时间优化稳定

散热: 420mm AIO水冷 或 定制分体水冷(压制350W TDP)

存储:

- 系统: 2TB NVMe Gen5 (读取12GB/s)

- 项目: 8TB NVMe Gen4 RAID0 (14GB/s)

- 归档: 20TB机械硬盘

显卡: RTX A4000 16GB (专业驱动认证,多屏支持)

外设: 4K显示器×2(光路图细节观察),色彩校准仪

预估性能:

- Zemax: 比配置A快15-20%(大缓存优势)

- FRED物理光学: 比配置A快25-30%

- 可处理复杂非球面、自由曲面、衍射元件

适用: AR/VR光学、医疗内窥镜、激光扫描系统、科研级设计

配置C:旗舰单路怪兽

plain

CPU: AMD Threadripper PRO 7995WX (96核)

- 手动超频: PBO2调优,全核5.0-5.2GHz

- 极限散热: 定制水冷头,双480mm冷排

- 关键: 仅启用32-48核心运行光学任务,其余核心隔离

主板: ASUS Pro WS WRX90E-SAGE SE

- WRX90芯片组,支持PRO 7000系列

- 供电: 32+3相,支持600W+持续输出

内存: 256GB DDR5-4800 ECC (8×32GB)

- 8通道满配(为其他应用预留,光学用4通道即可)

- 可升级至2TB(8×256GB)

存储: 全闪存架构

- 系统: 4TB NVMe Gen5

- 工作: 16TB NVMe Gen4 (4×4TB RAID0)

- 备份: 40TB NAS同步

显卡: RTX 6000 Ada 48GB (大型场景可视化)

系统优化:

- BIOS: 关闭SMT,关闭未使用核心,固定电压1.25V

- OS: Windows 11 + WSL2(Linux工具链)

- Zemax: 设置线程数=16-24(避免超线程惩罚)

预估性能:

- 单核性能: 接近配置A的95%

- 多任务: 可同时运行4-6个独立光学设计

- 适用: 光刻机照明、空间望远镜、国家级实验室

配置D:分布式优化集群(预算50万+,非单任务加速)

plain

节点1-4: 各配置B规格(TR PRO 7975WX,32核5.3GHz)

网络: 10GbE 或 InfiniBand HDR(结果同步)

存储: 共享NVMe-oF存储池(100TB+)

软件架构:

- Zemax OpticStudio ×4 license

- FRED ×4 license

- 自研Python/MATLAB调度脚本

工作模式:

- 参数化优化: 4组参数并行,各跑一个节点

- 蒙特卡洛容差: 1000次采样分4组并行

- 多方案对比: 4个不同设计同时优化

关键认知:

- 这不是"并行计算一个模型"

- 这是"同时计算4个不同模型"

- 单模型速度无提升,研发效率×44.3 绝对避免的"陷阱配置"

| 陷阱配置 | 问题 | 实际表现 |

|---|---|---|

| 双路Xeon Platinum | NUMA延迟+低频 | 比单路i9慢2-3倍 |

| EPYC 9004系列 | 频率过低(2.4GHz) | 光学仿真灾难 |

| Mac Studio (M2 Ultra) | 软件兼容性+内存带宽瓶颈 | Zemax无原生ARM版,转译性能损失40% |

| 服务器级ECC DDR4 | 频率过低(3200MHz) | 延迟高,拖累高频CPU |

| 多GPU工作站 | 光学软件不支持 | 闲置功耗+散热噪音 |

五、软件优化:榨干每一MHz

5.1 Zemax OpticStudio调优

系统设置:

ini

[Preferences] MaxThreadCount=16 # 限制线程数,避免超线程惩罚 UseAVX512=1 # 启用AVX-512指令集(需CPU支持) MemoryAllocation=Dynamic # 大内存系统启用动态分配 RayAimingPrecision=High # 光瞳瞄准精度(权衡速度/精度)

设计优化策略:

-

序列模式优先:非序列模式慢10-100倍,仅在必要时使用

-

表面类型简化:Even Asphere比Extended Asphere计算快30%

-

光线数优化:MTF计算只需足够采样(Nyquist×2),非越多越好

-

缓存复用:优化过程中锁定中间结果,避免重复追迹

5.2 FRED性能调优

Python

# FRED脚本优化示例 # 1. 光线分批处理,避免内存碎片 ray_batches = 100000 # 每批10万根光线 # 2. 提前编译表面数据(减少运行时解释) surface.precompute() # 缓存B样条、Zernike系数 # 3. 智能分裂阈值 split_threshold = 0.01 # 能量<1%终止追迹,平衡精度/速度 # 4. 并行控制(FRED MP版本) fred.set_thread_count(8) # 匹配物理核心数,非逻辑核心5.3 操作系统级优化

Windows 11:

powershell

# 电源计划:卓越性能 powercfg -duplicatescheme e9a42b02-d5df-448d-aa00-03f14749eb61 # 进程优先级 Get-Process *zemax* | Set-ProcessPriority -Priority RealTime # 隔离核心(专用光学计算) # MSConfig -> 引导 -> 高级选项 -> 处理器数=8(保留8核给Zemax)

Linux(Ubuntu):

bash

# CPU频率锁定 sudo cpupower frequency-set -g performance sudo cpupower frequency-set -d 4.5GHz -u 6.0GHz # 进程绑定(避免跨NUMA,单路也建议) taskset -c 0-15 opticstudio # 绑定到前16核 # 内存大页(减少TLB未命中) echo 1024 | sudo tee /proc/sys/vm/nr_hugepages六、2026-2028技术演进:光学仿真的未来

6.1 硬件技术突破

-

Intel Arrow Lake-S:6.5GHz+睿频,AI加速单元辅助优化算法

-

AMD Zen 5 Threadripper:单核5.5GHz+512MB L3,光学仿真终极形态

-

3D V-Cache扩展:消费级CPU 256MB+ L3,逼近服务器缓存容量

-

光学计算芯片:Lightmatter、Lightelligence的光子芯片,特定运算光速完成(2030年后实用化)

6.2 软件架构革新

-

Zemax GPU原生:2025R2计划支持CUDA加速非序列追迹(预计提速3-5倍)

-

AI辅助优化:神经网络替代部分光线追迹,实时像质预测

-

云原生光学仿真:Ansys Cloud Zemax,弹性扩展(但单任务仍受频率限制)

6.3 算法突破

-

路径空间正则化:减少蒙特卡洛噪声,同等精度需光线数减少50%

-

神经辐射场(NeRF)光学版:用神经网络编码光场,查询替代追迹

-

量子光学模拟:量子计算机模拟量子纠缠态光子行为

结语:在光的频率里舞蹈

光学仿真对硬件的挑剔,源于光本身的无质量、高速度、强相干性。当光子以纳秒级穿越复杂光学系统,数字世界必须以皮秒级精度模拟其每一次折射、每一次干涉、每一次量子跃迁。

给光学工程师的终极建议:

-

频率即正义:6GHz > 5GHz > 4GHz,每一MHz都值得追求

-

缓存是护城河:256MB+ L3让复杂表面计算如丝般顺滑

-

单路即真理:双路服务器的NUMA延迟是光学仿真的天敌

-

并行有天花板:16-24线程后,投入产出比断崖式下跌

-

GPU是未来但不是现在:2026年CPU仍是主力,GPU静候软件支持

在光学设计的精密世界里,正确的硬件配置是捕捉光子行为的显微镜。别让低频CPU模糊您的艾里斑,别让双路NUMA扭曲您的波前,别让盲目堆核浪费您的预算。

需要针对您的具体光学设计(如光刻机照明、AR光波导、激光雷达、空间相机)定制配置方案,或深入探讨Zemax编程(ZPL)、FRED脚本优化的硬件协同?欢迎进一步交流。

上一篇:没有了