当大模型遇见Hypermesh:AI驱动CAE前处理的算力重构——语音交互、AR可视化与自动化建模的硬件底座

时间:2026-03-03 12:41:52

来源:UltraLAB图形工作站方案网站

人气:71

作者:管理员

从"鼠标+键盘"到"语音+手势",从手工网格到AI自动生成——支撑智能前处理器的GPU渲染、LLM推理与实时几何计算硬件架构

CAE工程师的日常正在被重新定义。未来的前处理场景可能是这样的:工程师戴着AR头显,在空中"圈出"发动机缸体的螺栓孔区域,口述"请在此创建M8螺栓连接,预紧力80N·m",系统在3秒内完成几何清理、网格划分、材料属性赋予和边界条件设置——而这一切背后,是大语言模型的意图理解、计算机视觉的几何识别、实时光线追踪渲染、以及大规模稀疏矩阵的网格生成算法在协同运行。

这不是科幻,而是Hypermesh、ANSA等前处理器在2-3年内可能具备的功能。但要支撑这种"多模态智能前处理",传统的工作站架构已触及瓶颈:LLM推理需要显存、AR渲染需要GPU算力、几何引擎需要CPU单核性能、大型装配体需要海量内存。

第一章:AI驱动CAE前处理的技术架构与计算瓶颈

1.1 多模态交互层——从GUI到LUI(Language User Interface)

技术特征:

-

语音指令解析:将"材料名称为steel,弹性模量210000,泊松比0.3"转换为结构化数据

-

自然语言理解(NLU):理解"请修复当前视图内所有网格质量"中的上下文(当前视图、网格质量指标、修复策略)

-

多轮对话:支持"优化刚才那个区域"等指代消解

计算瓶颈:

-

LLM推理延迟:7B参数模型本地推理需<500ms才能保持交互流畅,14B模型需A100级GPU

-

语音识别实时性:端到端延迟<200ms,需专用NPU或GPU加速

1.2 AR/VR可视化层——沉浸式几何操作

技术特征:

-

手势识别:通过VR手柄或裸手识别"圈选"操作

-

空间锚定:将CAE模型锚定在真实桌面,支持多角度观察

-

实时渲染:PBR材质、阴影、半透明效果,支持千万级三角面片

计算瓶颈:

-

渲染帧率:VR需90fps×2(双眼)才能避免眩晕,4K×4K分辨率下像素填充率需求极高

-

几何传输:大型装配体(如整车模型>5000万面)需实时LOD(细节层次)切换

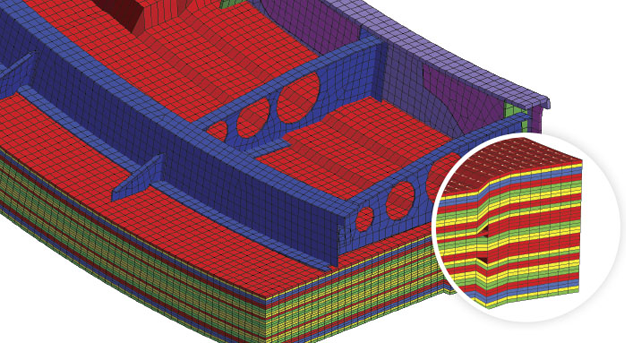

1.3 AI辅助建模引擎——从规则到学习

技术特征:

-

智能网格划分:根据几何特征自动选择单元类型(四面体/六面体)、尺寸函数

-

连接单元自动生成:识别螺栓孔、焊缝、胶粘区域,自动创建RBE2/CBUSH/焊缝单元

-

网格质量修复:基于强化学习(RL)的节点平滑算法,替代传统Laplacian smoothing

计算瓶颈:

-

几何搜索:在千万级网格中定位"红色区域"的螺栓孔,需空间索引(BVH/k-d树)加速

-

AI模型推理:网格质量预测模型(CNN/GNN)需GPU实时推理

1.4 后端求解器接口——多物理场耦合

技术特征:

-

一键多求解器导出:同一模型同时输出Nastran/Abaqus/LS-DYNA格式

-

结果预览:不解算即可预估应力热点(基于代理模型)

-

优化闭环:形状优化拓扑优化结果实时反馈到前处理

第二章:核心软件栈——从传统CAE到AI-Native

2.1 基础CAE平台(需AI增强接口)

-

Altair Hypermesh 2026+:期待中的AI插件接口(HyperWorks AI)

-

BETA CAE Systems ANSA:机器学习辅助的Batch Mesh

-

Siemens Simcenter:Teamcenter集成,支持AI驱动的知识重用

-

Dassault 3DEXPERIENCE:CATIA + SIMULIA,自然语言查询几何

2.2 AI/LLM推理框架

-

Ollama/vLLM:本地部署7B-13B代码专用模型(如CodeLlama、StarCoder)

-

LangChain/LangGraph:构建CAE专用Agent工作流(Tool Use:调用网格划分API)

-

Whisper.cpp:本地语音识别(避免云端传输几何机密数据)

-

TensorRT-LLM:GPU加速LLM推理,延迟<100ms/token

2.3 AR/VR开发平台

-

Unity 3D/Unreal Engine 5:CAE数据可视化(USD格式导入)

-

OpenXR:跨平台VR头显支持(Meta Quest 3、Apple Vision Pro)

-

NVIDIA Omniverse:实时光线追踪,支持大型装配体协作

-

WebXR:浏览器端轻量化AR预览

2.4 几何引擎与网格算法

-

OpenCASCADE:开源几何内核,支持布尔运算、倒角

-

CGAL:计算几何算法库(网格生成、修复)

-

PyMesh/Trimesh:Python几何处理,快速原型

-

ML-based Meshing:英伟达Modulus、DeepMind的MeshGraphNets

2.5 知识图谱与数据库

-

Neo4j:CAE知识图谱(材料-工艺-性能关联)

-

Vector DB (Pinecone/Milvus):存储历史模型Embedding,支持相似模型检索

-

PostgreSQL + PostGIS:几何数据库存储CAD/CAE模型版本

第三章:UltraLAB AI-CAE智能前处理工作站配置

配置A:个人AI-CAE工程师(AI辅助建模+轻量化AR)

定位:汽车/航空工程师,使用AI辅助完成80%重复性前处理工作

硬件规格:

-

CPU:Intel Core Ultra 9 285K(Arrow Lake,6.0GHz睿频,NPU 13 TOPS)

-

NPU用途:本地Whisper语音识别,释放GPU用于渲染

-

-

GPU:NVIDIA RTX 4090 24GB(或RTX 5090 32GB)

-

AI推理:运行14B参数LLM(INT4量化,约8GB显存)

-

AR渲染:Unity UE5实时光追,支持VR预览

-

CUDA加速:网格生成算法(TetGen/Gmsh GPU版)

-

-

内存:128GB DDR5-6000(双通道,支持千万级网格驻留)

-

存储:2TB NVMe Gen5(Hypermesh模型库+LLM本地权重)

-

VR设备:Meta Quest 3(无线串流)或 Apple Vision Pro(企业版)

-

输入设备:语音麦克风阵列(降噪)+ 3Dconnexion SpaceMouse(CAD导航)

预估价格:3-4万元(不含VR头显)

软件栈:

-

Windows 11 + WSL2(Ubuntu 22.04)

-

Hypermesh 2024 + 自研Python AI插件(调用Ollama API)

-

Unity 3D + OpenXR Plugin

-

Ollama(本地部署CodeLlama-13B)

配置B:团队智能CAE中心(多用户AR协作+云端LLM)

定位:研发中心CAE部门,5-10人共享AI前处理资源

硬件架构:

AI推理服务器(1台):

-

CPU:AMD EPYC 9655(96核,高并发请求处理)

-

GPU:4× NVIDIA A100 80GB(运行70B参数CAE专用大模型,支持多用户并发)

-

内存:512GB DDR5(缓存知识图谱和历史模型Embedding)

-

功能:自然语言理解、智能推荐、知识检索

AR渲染工作站(5台):

-

CPU:Ryzen 9 9950X(16核,高主频优化单用户体验)

-

GPU:RTX 6000 Ada 48GB(大显存支持整车级装配体VR渲染)

-

内存:256GB DDR5(本地缓存大型模型)

-

VR:每工位配备Varjo XR-4(单眼4K,工业级精度)

存储服务器:

-

20TB NVMe全闪存(版本控制+模型库)

预估价格:150-200万元(含5套VR工位)

配置C:企业级智能CAE云平台(AI自动生成+数字孪生)

定位:整车厂/航空主机厂,AI自动完成80%标准件前处理

硬件架构:

训练集群(微调CAE专用LLM):

-

8× NVIDIA H100 80GB(DGX H100)

-

功能:基于企业历史模型数据,微调7B-13B代码生成模型

推理集群(实时服务):

-

16× A100 80GB(Kubernetes管理)

-

功能:支撑100+工程师同时使用AI前处理助手

AR协作中心:

-

CAVE沉浸式系统(5面投影+光学追踪)

-

支持多人同时"进入"同一数字样机进行前处理评审

预估价格:1000万+(超算中心级)

第四章:关键技术实现路径

4.1 语音控制Hypermesh的实现(概念验证)

Python

# Python桥接Hypermesh Tcl脚本 + Whisper + LLM import whisper import ollama from hm_api import HypermeshAPI # 虚构的Hypermesh Python接口 model = whisper.load_model("base") hm = HypermeshAPI() while True: audio = record_audio() # 录制语音指令 text = model.transcribe(audio)["text"] # LLM解析意图 response = ollama.chat(model="codellama:13b", messages=[{ "role": "user", "content": f"Convert to Hypermesh Tcl: {text}" }]) tcl_script = response["message"]["content"] hm.execute_tcl(tcl_script) # 执行网格操作4.2 AR几何选择的延迟优化

-

空间索引:使用BVH(层次包围盒)加速射线-三角形求交(从O(n)到O(log n))

-

GPU拾取:利用CUDA在GPU端完成点击测试,避免CPU-GPU数据传输

-

预测渲染:基于眼动追踪(注视点渲染),降低 periphery 区域分辨率

4.3 AI网格质量修复的训练数据

-

数据收集:历史项目中的"坏网格-好网格"配对(百万级样本)

-

模型架构:Graph U-Net(处理非结构化网格数据)

-

部署:TensorRT优化,推理延迟<50ms/网格区域

结语:CAE工程师的"贾维斯"时代

当Hypermesh遇见大模型,当ANSA遇见AR,CAE前处理的门槛将被重新定义。未来的工程师可能不再需要记忆复杂的Tcl脚本,不再需要手工调整每个节点的位置,而是像《钢铁侠》中的托尼·斯塔克一样,通过自然语言和手势与"AI助手"协作完成建模。

UltraLAB AI-CAE智能工作站,以覆盖LLM推理、VR渲染、几何计算的异构算力,为这一未来提供硬件底座。从个人桌面到企业云端,让AI成为每个CAE工程师的"超级助理"。

【UltraLAB智能仿真事业部 | AI-CAE融合计算专家】 咨询专线:400-7056-800 微信号:xasun001

服务范围:CAE前处理工作站定制、LLM本地部署优化、AR/VR仿真可视化系统集成。支持Hypermesh、ANSA、Abaqus CAE等主流软件的AI增强开发。