在本地驾驭"DeepSeek R1级"智慧:32B大模型私有化部署的硬件炼金术

时间:2026-03-02 11:14:51

来源:UltraLAB图形工作站方案网站

人气:52

作者:管理员

当671B参数的云端巨兽遇见32B蒸馏版的本地精英——如何在单台工作站内实现媲美GPT-4的推理能力,且数据不出域、成本可控、响应零延迟?

2025年初,DeepSeek R1的发布如同一颗深水炸弹,不仅以开源姿态挑战了闭源模型的霸权,更以其惊人的671B参数MoE架构和低至几分之一的推理成本,重新定义了AI的性能基准。然而,对于企业研究院和敏感数据处理机构而言,"API调用"始终是戴着镣铐的舞蹈——数据出域的安全风险、按token计费的不可控成本、以及网络延迟对实时应用的桎梏,让"本地部署"成为刚需。

幸运的是,DeepSeek团队同步开源了基于Qwen2.5和Llama3.1蒸馏的32B参数版本。在数学推理(MATH-500)、代码生成(HumanEval)和逻辑推理任务上,这些"轻量化"模型展现出令人震惊的性能——在特定领域任务上,32B蒸馏版的准确率可达R1满血版的85-90%,而硬件门槛却从8卡A100集群降至单台高端工作站。

这不是妥协,而是一场"边缘智能"的革命。当32B模型在本地以FP16精度流畅运行,当推理延迟从网络的数百毫秒压缩到本地的20-50毫秒,当企业核心数据永远留在内网防火墙之内,我们意识到:AI民主化的真正标志,不是免费的API,而是可在本地机柜中自主掌控的算力主权。

然而,将32B参数、约60-80GB模型文件(FP16精度)的庞然大物塞进单台机器,并使其以生产环境所需的吞吐量(Throughput)和延迟(Latency)运行,这是一门精密的硬件配置艺术。显存容量、内存带宽、PCIe拓扑、量化精度——每一个变量的取舍都直接影响着"本地R1"的实际体验。

第一章:32B模型的硬件解剖学——为什么不是普通电脑能玩的游戏?

一个32B(320亿)参数的神经网络,在标准FP16(半精度浮点)格式下,仅权重(Weights)就需要64GB存储空间(32B × 2字节)。加上推理过程中的KV Cache(键值缓存)、激活值(Activations)以及系统开销,显存(VRAM)需求轻松突破72GB。

这意味着:

-

RTX 4090(24GB):无法直接运行FP16精度的32B模型,必须通过4-bit量化(GGUF/Q4_K_M格式)将模型压缩至约18-20GB,才能勉强装入显存,但精度损失显著(尤其在数学推理链CoT上)。

-

RTX A6000(48GB):可运行8-bit量化版(约36GB),适合大多数企业场景,是性价比甜点。

-

A100/H100(80GB):唯一能在FP16精度下原生运行32B模型且留有余量进行批处理(Batch Inference)的消费级/专业级方案。

内存墙(System RAM)的隐形杀机:

即使模型主要在GPU上运行,操作系统和推理框架(如vLLM、TensorRT-LLM)仍需在系统内存中维护模型副本、输入输出缓冲和中间结果。128GB DDR5内存是起步配置,256GB才能确保在处理长上下文(Long Context,32K tokens+)时不触发磁盘交换(Swapping)。

CPU的"交通警察"角色:

虽然推理计算 offload 至GPU,但数据预处理(Tokenizer)、批处理调度(Batching)、以及KV Cache管理仍依赖CPU。高主频(>5.0GHz)和大三级缓存(L3 Cache > 64MB)能显著降低端到端延迟。AMD Ryzen 9 7950X3D或Intel Core i9-14900K是单卡配置的理想选择;多卡方案则需Threadripper PRO或Xeon W的PCIe通道扩展能力。

第二章:量化技术——在显存与精度之间走钢丝

既然原生FP16对大多数工作站过于苛刻,量化(Quantization)成为本地部署32B模型的核心技术:

GGUF格式(Llama.cpp生态):

-

Q4_K_M:4-bit量化,将32B模型压缩至约18-20GB,可在RTX 4090 24GB上运行,速度约15-25 tokens/s。适合对话型应用,但在复杂数学推理时可能出现逻辑断层。

-

Q8_0:8-bit量化,约36-38GB,需RTX A6000 48GB或双卡RTX 4090(通过NVLink或PCIe P2P)。精度损失<2%,是生产环境推荐的黄金标准。

AWQ/GPTQ(HuggingFace生态):

-

激活感知权重量化(AWQ)保护关键权重矩阵,在4-bit下保持接近FP16的精度。

-

配合vLLM推理引擎的PagedAttention技术,可将KV Cache内存碎片化降低至<5%,显著提升长文本处理能力。

FP8(Hopper/Ada架构):

-

RTX 4090/6000 Ada的Tensor Core支持FP8精度,通过TensorRT-LLM编译,可在24-48GB显存内实现接近FP16的精度,速度提升2倍以上。

第三章:UltraLAB 32B本地部署硬件配置方案

针对DeepSeek-R1-Distill-Qwen-32B和DeepSeek-R1-Distill-Llama-70B(若预算允许)的本地部署,UltraLAB提供三级硬件方案:

方案A:极客入门型(单卡RTX 4090,量化运行)

目标人群:AI开发者、个人研究者、轻量级企业POC验证 硬件架构:

-

GPU:NVIDIA RTX 4090 24GB(非公版,加强散热)

-

运行模式:Q4_K_M量化,约18GB显存占用,留6GB给KV Cache(支持4K上下文)

-

性能预期:生成速度20-30 tokens/s(约15-20字/秒),适合单用户交互

-

-

CPU:AMD Ryzen 9 7950X3D(16核32线程,5.7GHz睿频,128MB L3缓存)

-

优势:大缓存加速Tokenize过程,高主频降低单用户请求延迟

-

-

内存:128GB DDR5-5600(双通道,低时序CL30)

-

必要性:加载Q4模型时系统内存需缓存约20GB,加上操作系统和中间件,64GB会触发OOM

-

-

存储:2TB NVMe Gen4 SSD(读取7000MB/s)

-

理由:32B模型文件(Q4格式约20GB,Q8格式约40GB)需快速加载,避免冷启动时的分钟级等待

-

-

散热:360mm一体式水冷(压制4090的450W TDP和CPU的170W)

-

软件栈:预装Ubuntu 22.04 LTS、CUDA 12.4、llama.cpp(CUDA backend)、Ollama(一键部署)

-

局限:无法运行FP16原生精度,多用户并发时显存迅速耗尽

方案B:专业生产型(RTX A6000 48GB,企业级部署)

目标人群:中大型企业私有知识库、科研机构、代码辅助开发团队 硬件架构:

-

GPU:NVIDIA RTX A6000 48GB(专业卡,ECC显存纠错,支持7×24运行)

-

运行模式:Q8量化(36GB)或FP16(配合CPU offload混合推理)

-

性能预期:Q8下40-50 tokens/s,支持2-3用户轻度并发;FP16下15-20 tokens/s(单用户)

-

稳定性:ECC显存防止长时间推理中的比特翻转错误,适合金融、医疗等严肃场景

-

-

CPU:AMD Ryzen Threadripper PRO 5975WX(32核64线程,5.0GHz睿频)

-

优势:支持8通道DDR5内存(提供204GB/s带宽),PCIe 4.0 x128通道可扩展多卡或高速网卡

-

-

内存:256GB DDR5-4800 ECC Registered(8×32GB)

-

配置:当处理32K长上下文时,KV Cache可能膨胀至20-30GB,需充足系统内存作为显存溢出缓冲(Offload)

-

-

存储:4TB NVMe Gen5 SSD(顺序读14000MB/s)+ 16TB HDD(模型库归档)

-

加速:PCIe 5.0 SSD确保大模型文件(FP16格式约64GB)在10秒内完成加载

-

-

网络:双10GbE网卡(支持RDMA),便于作为内部API服务器供全公司调用

-

软件优化:

-

vLLM部署:利用Continuous Batching技术,将GPU利用率提升至90%以上,支持动态批处理(最多8个并发请求)

-

TensorRT-LLM:将32B模型编译为优化引擎,FP8精度下性能提升2.5倍

-

量化校准:提供AWQ校准服务,针对企业特定领域数据(如法律条文、医疗记录)优化量化参数,降低精度损失至<1%

-

方案C:集群旗舰型(多卡A100/H100,满血性能)

目标人群:大型AI实验室、云计算服务商、需要替代OpenAPI的高并发场景 硬件架构:

-

GPU:2× NVIDIA A100 80GB PCIe(或SXM4版本,NVLink互联)

-

运行模式:FP16原生精度,模型并行(Tensor Parallelism)分布在两张卡上

-

性能预期:单用户60-80 tokens/s,支持10-20并发用户(动态批处理)

-

显存优势:160GB总显存可缓存多个32B模型实例(如同时加载R1-32B和Qwen-72B),或支持超长上下文(128K tokens)

-

-

CPU:双路AMD EPYC 9554(64核/路,共128核256线程)

-

职责:处理高并发请求的预处理、负载均衡、以及多模型调度

-

-

内存:1TB DDR5-4800 ECC(16×64GB)

-

用途:作为GPU显存的"二级缓存",通过ZeRO-Infinity技术将优化器状态 offload 至CPU内存(若进行轻量级微调)

-

-

存储:8TB NVMe SSD(RAID 0,读写>20GB/s)+ 100GbE网络存储(NFS)

-

高可用:支持多机集群扩展,通过Ray Serve或TGI(Text Generation Inference)框架实现负载均衡

-

-

互联:NVLink Bridge(若使用A100 SXM4)或PCIe 4.0/5.0 Switch,确保GPU间带宽>200GB/s,避免张量切分时的通信瓶颈

-

推理框架:

-

DeepSpeed Inference:支持ZeRO partitioning,将大模型状态分片到多卡

-

vLLM + PagedAttention:极致的KV Cache管理,支持比传统方法高10倍的并发吞吐量

-

第四章:性能调优的隐秘艺术——让32B模型跑满算力

硬件只是画布,软件优化才是画笔。UltraLAB针对本地部署提供以下调优策略:

1. 内存统一寻址(NUMA优化):

对于Threadripper/EPYC平台,确保推理进程的内存分配与GPU所在的NUMA节点亲和(Affinity),避免因跨Die访问内存导致的延迟抖动(Jitter)。

2. 动态批处理(Dynamic Batching):

使用vLLM或TGI的continuous batching功能,将多个用户的短请求合并为一次前向传播(Forward Pass),将GPU利用率从单用户的30%提升至并发的85%+。

3. FlashAttention-3:

在Ada/Hopper架构(RTX 4090/A100/H100)上启用FlashAttention-3,通过减少HBM访问次数,将长上下文(>8K)的推理速度提升2-4倍,显存占用降低至原来的1/5。

4. 投机采样(Speculative Decoding):

部署一个小型Draft模型(如7B参数)快速生成候选Token,再由32B模型验证,可在保持输出质量的同时将速度提升2-3倍。这需要额外的显存空间(约8GB),适合A6000及以上配置。

5. 模型编译优化:

使用

torch.compile(PyTorch 2.0+)或TensorRT-LLM将Python动态图转为静态计算图,融合内核(Kernel Fusion)减少CUDA启动开销,在RTX 4090上可获得20-30%的加速。

第五章:应用场景——本地32B模型能做什么?

代码辅助开发(AI Coding):

在本地IDE(VS Code + Continue插件)中调用32B模型,代码补全延迟<100ms,且代码永不发送至外部API。特别适合银行、军工等涉密开发环境。

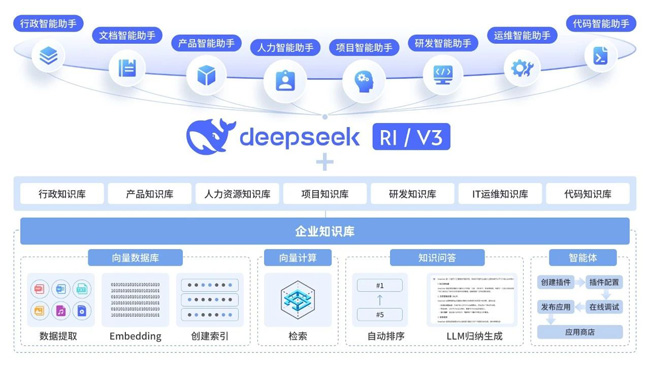

私有知识库问答(RAG):

配合本地向量数据库(Milvus/Faiss),32B模型的指令遵循能力足以处理复杂的过滤、总结、对比任务。在企业内网构建"不会泄密的ChatGPT"。

科研数据分析:

化学分子式推断、生物基因序列分析、物理公式推导——32B的推理链(Chain-of-Thought)能力在本地工作站上即可解锁,无需排队等待云端API。

实时客服与营销:

在电商大促期间,本地部署的32B模型可承受每秒数百次的咨询请求(配合动态批处理),且响应时间稳定在50ms以内,避免云服务商的限流(Rate Limiting)。

结语:算力民主化的最后一公里

DeepSeek R1的出现证明了"小模型+强化学习"路线的可行性,而32B蒸馏版的成功则让这种能力触手可及。不再需要向云服务商支付高昂的API账单,不再需要担心核心数据流经第三方服务器,不再需要在网络故障时面对"Service Unavailable"的绝望。

一台配置得当的工作站,一颗强大的GPU,加上精心调优的量化策略,就能在本地拥有一个"私人DeepSeek"。这不仅是成本的胜利,更是数据主权的回归。

UltraLAB大模型本地部署解决方案,以覆盖从RTX 4090到H100的全谱系硬件,配合经过验证的vLLM/TensorRT-LLM部署方案,为企业和研究机构提供"开箱即用"的私有化AI算力。

让你的智慧,真正留在你的机房。

【UltraLAB技术团队 | 企业级AI大模型本地部署专家】

咨询热线:400-7056-800

微信号:xasun001

上一篇:没有了